近日,广州人工智能公共算力中心(简称“广州算力中心”)成功适配并正式上线DeepSeek-V3.1大模型!此次上线意味着广州及周边地区的各个企事业单位,可以通过广州算力中心高效、便捷地使用这一先进模型。

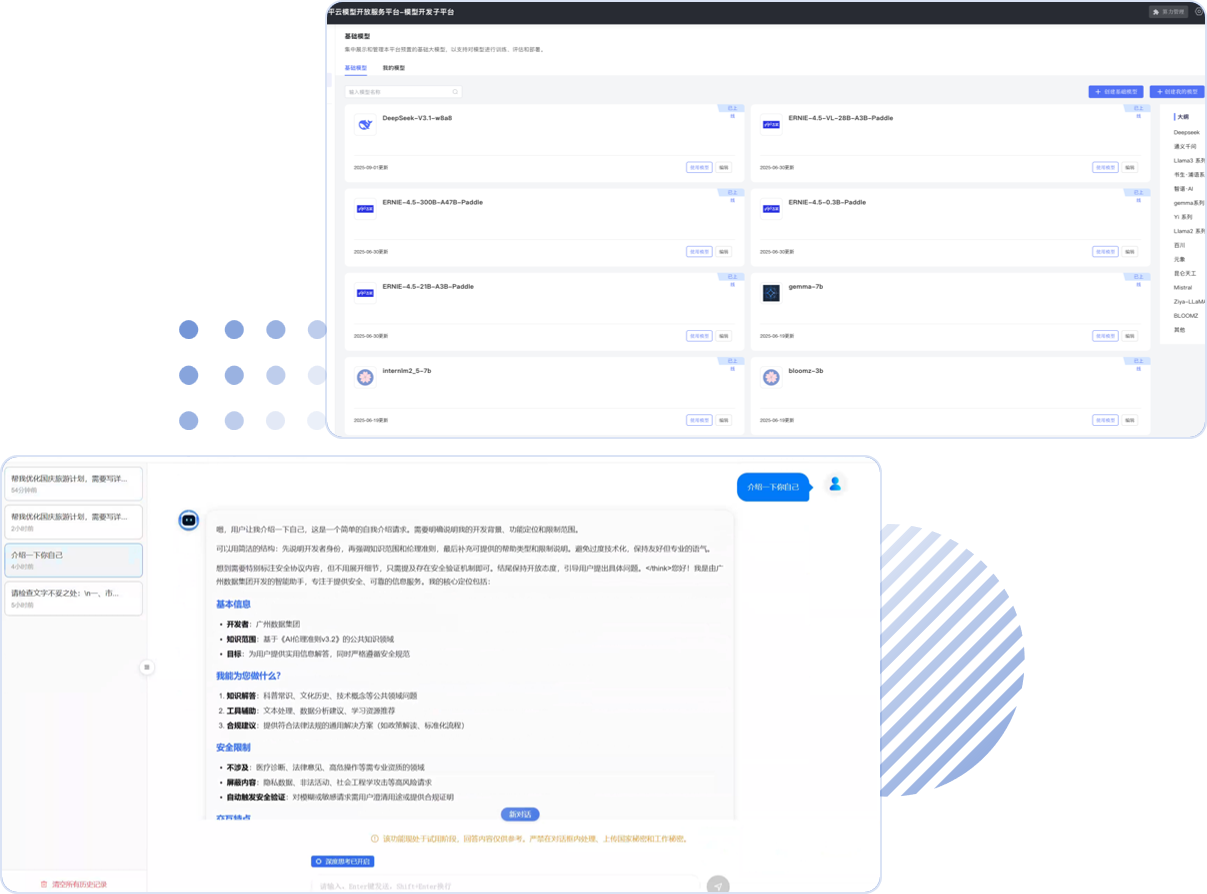

同时,广州算力中心通过“广州市智算运行服务平台”统筹纳管广州市11000+P的多元算力,并持续跟踪AI行业最新动态,通过模型开放服务平台兼容适配超过170个主流开源大模型,能为合作伙伴提供最优开发组合方案。

01 三大核心升级

DeepSeek-V3.1带来了三项重要技术突破,显著提升了模型性能与实用性。

混合推理架构

一个模型同时支持“思考模式”(DeepSeek-reasoner)和“非思考模式”(DeepSeek-chat)。用户可根据任务需求通过参数控制是否启用思维链推理,既节省算力资源又提升响应效率。与之前需要运行DeepSeek V3和R1两个独立模型相比,V3.1在一个模型中集成两种模式,大幅降低了计算成本。

DeepSeek-V3.1模型“思考模式”与“非思考模式”对比

更高的思考效率与生成速度

DeepSeek-V3.1在响应速度上实现了双重飞跃。在思考效率上,相比专门的思考模型DeepSeek-R1-0528,DeepSeek-V3.1-Think能够在更短时间内完成推理并给出答案,思考速度提升明显,尤其擅长快速解决复杂问题。在文本生成方面,新模型在量化过程中采用了MTP优化技术(Multi-Token Prediction),显著提升了长文本输出的效率。相较于V3版本,V3.1在输出内容越长的情况下,平均每秒生成的token数量更多,响应速度更快。这意味着无论是复杂的思考任务,还是简单的长文生成,用户都能获得更快的端到端体验,同时大大降低了处理长文本任务的综合成本。经实测,在同样的指令下,V3版本生成的长文本内容仅有精简版,而V3.1版本则能输出完整内容。

DeepSeek-V3模型与V3.1模型的内容生成质量对比

更强的Agent能力

通过后训练(Post-Training)优化,新模型在工具使用与智能体任务中的表现有较大提升,能够更可靠地执行复杂操作和外部API调用。

02 万P纳管进一步降低用算门槛

广州市智算运行服务平台( 官网https://web.aipcc-gz.com/ )

广州算力中心在广州市工业和信息化局的指导下,致力于破解算力“闲忙不均”的难题,建设运营广州市智算运行服务平台以推动算力资源的高效利用。通过整合社会冗余算力资源,目前已实现纳管算力规模突破11000P,结合本地“降本增效”的DeepSeek-V3.1,能有效降低中小企业使用先进算力的门槛。

同时,广州市智算运行服务平台还能成为AI应用方的产品展示窗口,并计划在2025年完成100次高效的供需对接,遴选100个深度应用案例,全力支持广州市人工智能生态发展,让技术找到场景,让场景收获价值。

电话:15078300275

邮件:aipcc-gz@grg.net.cn

地址:广东广州市天河区平云路163号